„Deepfake-Geographie“: Forscher warnen vor falschen Satellitenbildern

Deepfakes gelten schon lange als besonders gefährliches Manipulationswerkzeug im Internet. Durch Künstliche Intelligenz veränderte Videos und Bilder können oft täuschend echt aussehen. Nicht nur Gesichter können gefälscht werden, sondern auch Satellitenbilder. Forscher an der University of Washington haben in einer neuen Studie festgestellt, dass jetzt schon extrem real aussehende Fake-Satellitenbilder möglich sind. Unter anderem im militärischen Bereich könnte die sogenannte „Deepfake-Geographie“ zu einer mächtigen Waffe werden.

Diese App produziert realistische Deepfake-Videos in Sekunden und ist in China ein viraler Hit

„Technologie gibt es bereits“

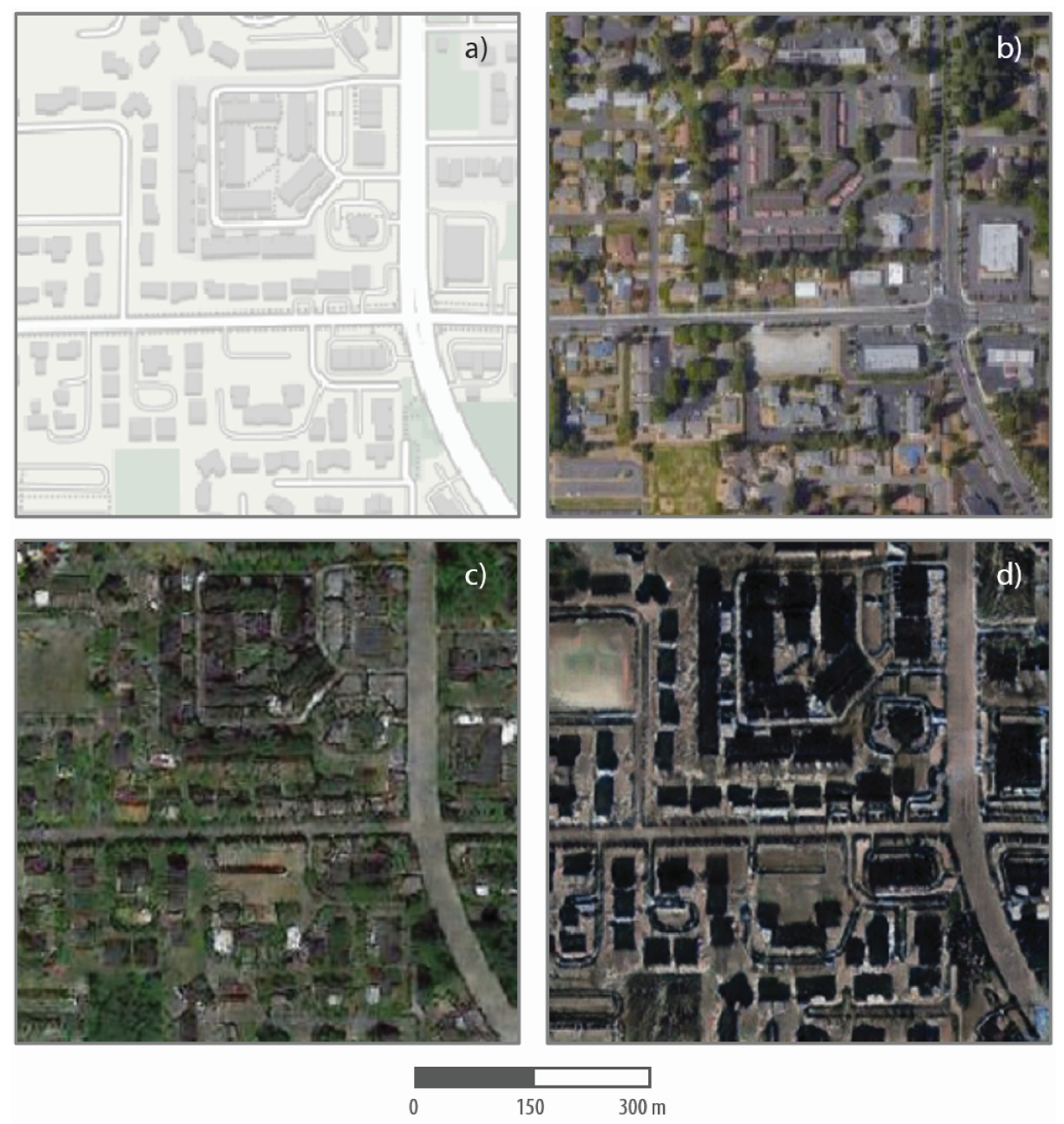

Das Forschungsteam hat gewöhnliche Deepfake-Methoden eingesetzt, um Satellitenansichten der drei Städte Seattle, Tacoma und Peking zu vereinen. Daraus entstand ein neues, authentisch wirkendes Stadtbild. „Hierbei handelt es sich nicht nur um ‚Photoshopping‘, die Daten sind extrem realistisch. Die Technologie dafür gibt es bereits“, warnt Studienleiter Bo Zhao. Mit seinen Kollegen hat der Geographie-Assistenzprofessor versucht, eine Methode zur Erkennung solcher manipulativen Bilder zu finden.

Ein wichtiges Detail bei Deepfake-Geographie seien die Schattenwürfe von Gebäuden. Diese würden sich bei Verschmelzungen von echten Bildern oft an unpassenden Stellen zeigen. Beispielsweise könnten sie bei zu kleinen Häusern auftauchen. Auch Farben von Grünflächen könnten falsche Bilder identifizieren. Für das menschliche Auge sei das allerdings oft zu schwer. Deswegen sei ein eigener Algorithmus für die Entlarvung der Deepfakes nötig.

Gefahr bei Marine-Überwachung

Laut den Forschern könnten selbst falsche Satellitenansichten gefährliche Fehlinformationen verbreiten. Es sei so unter anderem möglich, Katastrophen wie einen Häuserbrand zu simulieren. Besonders bedenklich sei diese Technologie im militärischen Bereich. Vor allem bei der Überwachung von möglicherweise feindlichen Marine-Schiffen kommen häufig Satelliten zum Einsatz. Realistische Fälschungen könnten bei solchen Observationen eine Gefahr darstellen.

Bo Zhao zufolge zeigt die Studie außerdem, dass Satellitenbilder nicht unfehlbar sind. „Fotos und andere raumbezogene Aufklärungsmethoden können nicht absolut verlässlich sein. Wir wollen in Zukunft mehr Gegenmaßnahmen wie Faktenchecks einsetzen“, so der Studienleiter. Geographen bräuchten ihre eigenen Tools, um authentische Daten aus den falschen Bildern herausfiltern zu können.