Erste Apple Vision Pro in Österreich: Auf der Suche nach der Killer-App

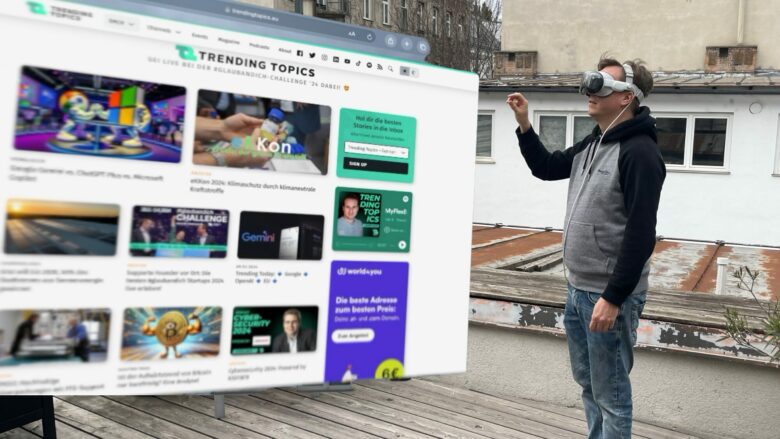

Es ist natürlich ein cooles Gefühl, das Gerät am Kopf zu haben, mit dem US-amerikanische Tech-Influencer sich in den letzten Tagen Millionen Views bei Youtube holten. Wenn man die richtigen Leute kennt, muss man nicht mehr in die USA reisen, um die Apple Vision Pro auszuprobieren – man muss nur zum Hackathon von Florian Bauer, dem CEO von Engage Technology, eingeladen worden sein. Bauer hat sich darum bemüht, das aktuell begehrte Stück Tech nach Österreich zu importieren (thx Florian 🙌) und gleich einen Hackathon zu veranstalten (mehr dazu weiter unten).

Wie ist es nun, den „Face Computer“, auf den so viele gewartet haben und von dem so viel erwartet wird, zu tragen? Hier unsere Eindrücke aus dem Hands-on in Wien:

Immersives Erlebnis

Apple liefert die aktuell ausgereifteste VR-Brille der Welt ab, und auch die wohl teuerste. Ja, richtig gelesen: Auch wenn man seine Umwelt sehen kann, es ist und bleibt Virtual Reality. Denn Kameras filmen das Geschehen und bringen es in Fast-Echtzeit (ca. 12 Millisekunden Verzögerung) auf die zwei Displays vor den Augen des Trägers mit jeweils 3.386 Pixels per Inch (ppi). Das ist viel mehr als die Meta Quest 3 (1.218 ppi) schafft, und deswegen ist die Optik auch ziemlich gut. Unsere Takeaways:

- Passthrough: Das sehen der echten Umgebung durch die Fast-Live-Übertragung der Außenkameras ist ziemlich gut. Die Umgebung ist etwas dunkler als in der Realität, und auch wenn man die Pixel mit freien Auge erkennen kann, weiß man im Vergleich zum normalen sehen. Da sind Pixel, das ist ein Display, das ich da gerade sehe.

- Schärfe: Die Vision Pro rechnet immer nur genau das scharf, was man gerade ansieht, der Rest ist ein wenig unscharf. Erst, wenn man ganz nah an Objekte herangeht, sieht man, dass es unscharf wird. Wofür es nicht reicht, ist, kleinen Text einwandfrei lesen zu können. Hält man sich etwa das eigene Smartphone vors Headset, dann kann man dort dargestellte kleine Schrift wie etwa in Messaging-Apps nicht scharf lesen.

- Virtual Reality: Durch Drehen am Rädchen, das an das der Apple Watch erinnert, kann man von Umgebungssicht (Passthrough“) stufenlos auf Virtual Reality wechseln. Das ist dann doch atemraubend, wenn man plötzlich mitten in einer Mondlandschaft steht. Dank der sehr scharfen Micro‑OLEDs das derzeit sicher schärfste VR-Erlebnis am Markt.

- Starker Sound: Die an den Trageriemen des Headsets eingebauten Speaker bringen starken, kristallklaren Sound, der die Immersion perfekt macht. Schaltet man etwa einen Film an, dann bekommt man von seiner Umgebung nicht mehr viel mit und fühlt sich richtig abgeschottet von der Realität. Da es keine In-Ear-Hörer sind, können nahestehende Personen aber doch mithören, was man selbst gerade hört.

- Die „Augen“: Damit Personen in der Nähe sehen können, wohin der Träger mit seinen Augen gerade blickt, hat Apple außen ein Display verbaut. Wenn es blau-violett leuchtet, dann ist der Träger in VR, wenn er via Passtrough seine Umgebung sieht, dann stellt das Display seine Augen dar. Wie in der Werbung sieht das aber nicht aus, das Display ist viel zu schwach und spiegelt stark, um wirklich etwas erkennen zu lassen. Da muss Apple nachbessern, oder lässt es bei der nächsten Generation weg.

Steuerung

Anders als viele andere VR-Brillen wir die Vision Pro hauptsächlich mit Blicken sowie Hand- und Fingergesten gesteuert, es braucht dazu keine Hand-Controller. Das funktioniert nicht zu 100 Prozent perfekt, aber schon sehr gut. Fast immer erkennt die Brille, wenn man Daumen und Zeigefinger zusammen tippt, um etwas anzuwählen.

- Eye Tracking: Vier Kameras mit Blickbewegungsmessung registrieren jede Bewegung der Augen und berechnen stets, wohin der User blickt. Das dient auch dazu, um Steuerelemente der Software auszuwählen. Daran muss man sich erst einmal gewöhnen, weil man das von anderen Geräten nicht gewohnt ist – immerhin starrt niemand exakt eine App an, um sie auch zu öffnen. Man hat den Dreh aber schnell heraus, was aber auch bedeutet, dass der Kopf ständig in Bewegung ist, je mehr Fenster man und sich herum in den virtuellen Raum stellt.

- Gestensteuerung: Neben den Displays und dem Eye Tracking die große Stärke der Vision Pro. Die Gesten und Fingerbefehle erkennt das Gerät dank nach unten gerichteten Sensoren sehr sehr gut. Zu Beginn fuchtelt man mit den Händen vor dem Körper herum, aber das ist gar nicht notwendig, man kann die Hände auch unten vor dem Bauch lassen oder in den Schoß legen, um steuern zu können. Das hat die Vision Pro der Konkurrenz definitiv voraus.

- Virtuelle Tastatur: Ja, es gibt auch eine virtuelle Tastatur in der Virtual Reality, um etwa URLs in den Browser zu tippen. Die Tastatur erscheint in Arm-Reichweite vor der eigenen Person, und man kann wirklich mit den Fingern darauf tippen. Für Profis mit 10-Finger-System ist das aber nichts, sondern eher ein Behelfsmittel, wenn die Sprachsteuerung mal nix versteht.

Ökosystem

Der eigene App Store der Vision Pro bietet aktuell etwa 600 Apps, die aber nur mit einem US-Account zugänglich sind. In Europa ist man ohne Tricks also auf die vorinstallierten Apps beschränkt. Nun liegt es an den Developern da draußen, spannende Apps zu schreiben, die Mehrwert auf die VR-Brille bringen.

- Kaum 3D-Inhalte: Aktuell kann man nur wenige 3D-Inhalte auf der Vision Pro nutzen, das meiste spielt sich dann doch in 2D ab. Egal, ob man YouTube im Browser, Apple TV+ oder die Fotos-App öffnet, sie erscheinen als große virtuelle Fenster – so als würde man eine Leinwand in den Raum spannen und darauf dann Inhalte projizieren. Das kann schon beeindruckend sein, wenn man einen Film auf einer „Leinwand“ abspielt, die mehrere Stockwerke groß ist.

- Starker Fokus auf die Apple-Welt: Apple-Geräte funktionieren am besten – mit Apple. Das merkt man etwa an der Funktion „Mac Virtual Display“, mit der man das Display seines Apple-Computers in die VR bringen kann. Dort kann man auch alles bedienen und quasi in einem virtuellen Büro arbeiten. Aber ob sich das außerhalb von Ausnahme-Situationen wie im Flugzeug durchsetzen wird, ist zweifelhaft. Wer wirklich drei Monitore zum Arbeiten braucht, hat sie sowieso längst im Büro stehen.

- Killer-App fehlt noch: Nach der ersten Nutzung, wenn man mal alles, was so vorinstalliert durch hat, dann fragt man sich: Wenn ich das Ding heute noch fünf Stunden verwenden könnte, was würde ich damit eigentlich tun? Genau, es fehlt definitiv noch die Killer-App für das Gerät (siehe unten).

Tragekomfort

Die Apple Vision Pro ist zu großen Teilen aus Aluminium und Glas, und das wirkt sich natürlich auf das Gewicht aus. Sie wiegt etwa 650 Gramm, ohne dem externen Akku, wohlgemerkt. Dieser ist mit einem Kabel mit der Brille verbunden und wird etwa in die Hosentasche gesteckt. Wer will, kann über diesen Akku direkt an die Steckdose gehen, denn der Akku hält nur etwa 2 bis 2,5 Stunden.

- Bänder: Es werden zwar zwei Kopfbänder mitgeliefert, aber realistischerweise wird man meistens eines, und zwar das fester sitzende „Dual Loop Band“ (mit Träger über den Oberkopf) gegenüber dem „Solo Knit Band“ bevorzugen. Zweiteres ist eher für kürzere Nutzungszeiten gedacht – aber am Ende wird man das Hin- und Hermontieren lassen.

- Gewicht: Die etwa 650 Gramm machen sich schnell bemerkbar. Beim Schwenken des Kopfes spürt man das Gewicht der Brille deutlich. Schon nach einer kürzeren Nutzungszeit von 15 Minuten hat man deutliche Abdrücke der Brille im Gesicht.

- Der Akku: Wer nicht sprichwörtlich an der Steckdose hängen will, der muss sich den mitgelieferten Akku-Pack in der Größe eines Smartphones in die Hosentasche stecken. Läuft man wirklich draußen mit der Vision Pro herum, dann kann man das etwa 2 Stunden tun. Wichtig dabei: Die Brille via Smartphone-Hotspot mit dem Internet verbinden.

Fazit:

Die Apple Vision Pro ist sicher ein beeindruckendes Stück Technologie, das neue Maßstäbe in der Welt der VR-Brillen setzt. Mit einem Preis von 3.500 Dollar aufwärts sowie keinem klaren Einsatzgebiet bleibt sie aber vorerst ein Gerät für Liebhaber:innen und Early Adopter, die unbedingt zu Beginn der neuen Apple-Ära an Bord kommen möchten. Die meisten anderen werden auf weitere Generation der Vision-Brille warten – und bis dahin auch nicht wirklich etwas verpassen.

Die Entzauberung der Apple Vision Pro

Auf die Suche nach einem Einsatzzweck machten sich am Wochenende auch viele Developer aus Österreich, die bei dem Vision Pro-Hackathon mitmachten und mit zahlreichen Ideen für neue Apps ankamen. Was viele von ihnen aber schnell feststellen mussten: Apple gibt ihnen nur sehr eingeschränkt APIs und Technologien frei, über die sie mit ihren Anwendungen andocken könnten. Das Eyetracking oder der Video-Feed der externen Kameras etwa können nicht angesteuert werden, Zugriff auf Kameras und Sensoren wird nicht ermöglicht – mit der Folge, das sich viele App-Ideen gar nicht umsetzen lassen.

Das Musik machen mittels Blicken auf einem virtuellen Instrument oder ein virtuelles Overlay beim Staubsaugen, dass zeigt, wo man schon gesaugt hat, sind derzeit technisch eigentlich gar nicht möglich. Möglich ist somit auch nicht, virtuelles Informationen passend über die Echtwelt zu legen, wie man es etwa bei Augmented Reality erwarten würde. Das schränkt die App-Entwicklung für die neue Hardware und ihr Betriebbsystem visionOS doch stark ein.

„Die Vision Pro liefert ganz gut, was sie verspricht, aus Developer-Sicht hat Apple alles richtig gemacht, und die Entwicklung macht Spaß. Die Probleme der Brille sind das Gewicht und die Usecases, für die man sie verwendet. Das Eyetracking ist zwar cool, aber nicht wirklich verwendbar für 3rd Party App Developers, und damit ist sie am Ende einfach eine teure VR-Brille ohne Gaming-Ökosystem“, so Entwickler Florian Bauer. Apple hat für visionOS das Entwickeln mit SwiftUI, ARKit, Xcode, Reality Composer Pro sowie Unity ermöglicht und versucht damit, Developern mit bekannten Frameworks entgegen zu kommen.

„Ich verstehe den Hype, aber es ist nicht der große Sprung, wie es damals das iPhone war“, sagt etwa Simon Auer, CEO des Software-Studios marqably, der beim Hackathon mit dabei war. Man sei mit viele Ideen gekommen, um neue Anwendungen auf Basis des Augen-Tracking zu bauen, hätte dann aber „relativ schnell realisiert dass wir gar kein Zugriff auf diese APIs haben.“

Apple verwehrt Entwickler:innen Zugriff auf Sensoren und Co.

„Die Vision Pro Hardware hat mich echt begeistert. Bei optimaler Beleuchtung vergisst man manchmal kurz dass man eigentlich einen Bildschirm ansieht und nicht die reale Welt. Ausschlaggebend für den Erfolg der Vision Pro werden aber die Apps sein – denn ohne gute Apps bleibt die Vision Pro eine teuere Spielerei. Im Netz finden sich geniale Konzeptideen von Designern für starke Vision Pro Apps – diese werden auch in vielen Reviews als mögliche Zukunft des Geräts gezeigt“, sagt Developer Patrick Wolowicz von subzero.eu software (u.a. Stadt Wien, Bikemap), der beim Hackathon ebenfalls dabei war.

Und weiter: „Das Dilemma ist jedoch, dass sich aufgrund von Apple’s Privacy-Bedenken mit dem aktuellen SDK viele dieser Ideen nicht realisieren lassen, da Apple Entwicklern den Zugriff auf verschiedene Sensoren, wie die Kameras oder Eyetracker, verwehrt. Entscheidend für die Umsetzung dieser Zukunftsvisionen wird sein, ob Apple es schafft, uns Entwicklern Zugang zu mehr Daten von diesen Sensoren zu gewähren ohne dabei auf Privacy für User:innen zu verzichten.“