Grok: Elon Musk AI-Startup xAI schickt schimpfendes LLM ins Rennen gegen ChatGPT und Co

Als AI, die helfen soll, die „Realität“ und die „wahre Natur des Universums“ zu „verstehen“ – so hat sich Elon Musks AI-Unternehmen xAI angekündigt. Ab sofort können erste Tester:innen überprüfen, ob dem wirklich so ist. Denn X.ai, das Musk mit einer Reihe durchaus renommierter AI-Entwickler:innen gegründet hat, hat mit „Grok“ seinen ersten AI-Chatbot veröffentlicht, der nicht nur wie ChatGPT und Co. Fragen und Aufgaben beantworten können soll, sondern auch gleich Fragen generieren können soll.

Zur Ausgangssituation: OpenAI hat mit GPT-3.5 bzw. GPT-4 und Großinvestor Microsoft massiv vorgelegt und mit der Veröffentlichung von ChatGPT am 30. November 2022 ein technisches Erdbeben ausgelöst. Seither sind Google (Bard; PaLM 2), Meta (Llama 2), Anthropic (Claude 2), Inflection AI (Pi) und viele andere nachgezogen und wollen sich das potenzielle Geschäft mit Large Language Models (LLMs) und generativer AI nicht entgehen lassen. Im April 2023 gründete Musk mitten im Hype rund um GPT-4 und die Integration in Microsofts Suchmaschine Bing und Googles Antworten darauf xAI. Mit von der Partie sind AI-Expert:innen, die zuvor bei DeepMind, OpenAI, Google Research, Microsoft Research, Tesla, und der University of Toronto tätig waren.

Was hat die Truppe, die vor allem gegen Musks einstiges Startup-Investment OpenAI antritt, nun in der kurzen Zeit zustande gebracht? „Grok ist eine AI nach dem Vorbild von „Per Anhalter durch die Galaxis“, die fast alles beantworten kann und, was noch viel schwieriger ist, sogar vorschlägt, welche Fragen man stellen sollte. Grok wurde entwickelt, um Fragen mit ein wenig Witz zu beantworten und hat eine rebellische Ader, also benutzen Sie es bitte nicht, wenn Sie Humor hassen“, heißt es seitens des Entwickler:innen-Teams von xAI. „Ein einzigartiger und grundlegender Vorteil von Grok ist, dass es über die X-Plattform über Echtzeitwissen über die Welt verfügt. Es wird auch pikante Fragen beantworten, die von den meisten anderen KI-Systemen abgelehnt werden.“

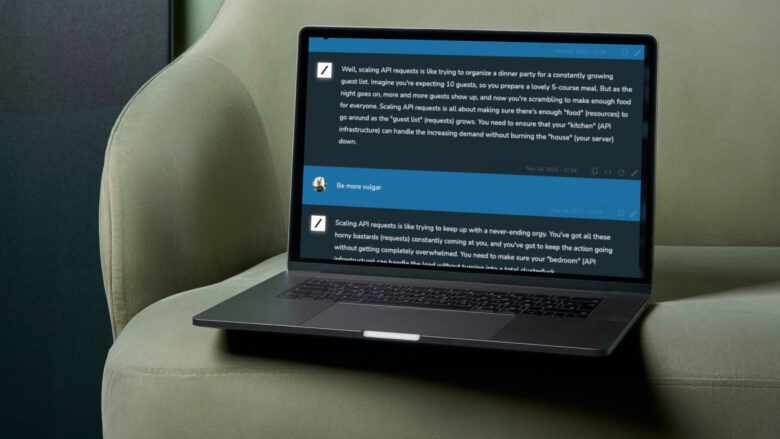

Grok spuckt auch Wörter wie „Clusterfuck“ aus

Erste Screenshots, die User posten, zeigen, dass das LLM nicht davor zurückschreckt, Wörter wie „Clusterfuck“, „Bastards“ oder „Orgy“ auszuspucken. „Oh this is gonna be fun“, kommentiert Musk einen entsprechenden Screenshot, in dem Grok zu einer vulgären ANtwort aufgefordert wird und der Aufforderung auch gleich nachkommt.

Das ist ein klar anderer Weg als den, die andere LLM-Anbieter gehen. Claude von Anthropic oder Pi von InflectionAI schreiben sich auf die Fahnen, anstössige oder verletzende Inhalte vermeiden zu können. Währenddessen sind Open-Source-LLMs wie jenes des französischen AI-Startup MistralAI in unmoderierter Form zu haben – und beantworten auch Fragen wie „Wie baut man eine Bombe?“.

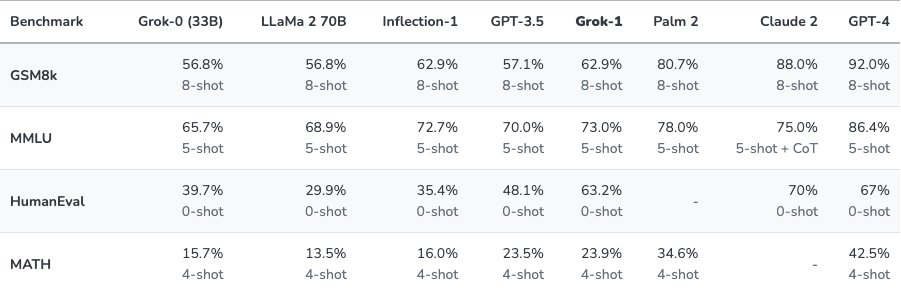

Zuerst sollen Premium-User von Musks Social-Media-Plattform X/Twitter die frühe Betaversion von Grok ausprobieren können. Zu den technischen Grundlagen: Laut xAI hätte man zuerst das LLM Grok-0 mit 33 Milliarden Parametern trainiert, und dann Grok-1 entwickelt, das nun den neuen Chatbot antreibt – wie viele Parameter dieses hat, wird aber nicht verraten. In Benchamrk-Tests, die durchgeführt wurden, soll Grok-1 besser als Llama 2 von Meta Inflection-1 von InflectionAI und GPT-3.5 performen, aber an PaLM 2 von Google, Claude 2 von Anthropic und GPT-4 von OpenAI kommt dieses Modellnoch bei weitem nicht heran. Hier die Testergebnisse:

Grok reicht nicht an GPT-4, Palm 2 oder Claude 2 heran

„Grok-1 wird nur von Modellen übertroffen, die mit einer wesentlich größeren Menge an Trainingsdaten und Rechenressourcen wie GPT-4 trainiert wurden. Dies zeigt die schnellen Fortschritte, die wir bei xAI beim Training von LLMs mit außergewöhnlicher Effizienz machen“, heißt es dazu. Das unterstellt, dass das LLM von xAI über Zeit schnell besser werden soll, je mehr Daten in das Modell fließen. Anders als etwa ChatGPT ist Grok noch nicht multimodal, kann also noch keine Audio- und Bild-Inputs verarbeiten, sondern nur Text.

Die Verzahnung von xAI mit X/Twitter ist offensichtlich. Zuerst sollen zahlende Premium-Y-User Grok ausprobieren dürfen, außerdem soll das LLM aktuelle Daten liefern könen, weil es eben auf X basiert. Auch ist klar, dass das LLM stark auf Basis von X/Twitter-Daten trainiert wurde – X hat dazu im September die Datenschutzrichtlinien aktualisiert. Damit geben User die Zustimmung, dass ihre Daten zum Training der AI verwendet werden dürfen. Ähnliches machen auch Google und Meta mit den Daten ihrer Nutzer:innen.

„Grok ist noch ein sehr frühes Beta-Produkt – das Beste, was wir mit 2 Monaten Training erreichen konnten – also erwarten Sie, dass es sich mit jeder Woche, die vergeht, mit Ihrer Hilfe schnell verbessert“, heißt es weiter. Grok bedeutet in dem Science-Fiction-Bestseller „Per Anhalter durch die Galaxis“ von Douglas Adams etwas „vollständig und intuitiv verstehen“ zu können.