KI: Wie Künstliche Intelligenz nachhaltiger werden soll

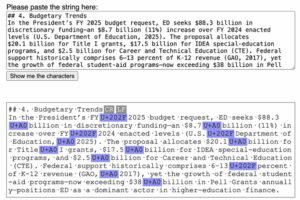

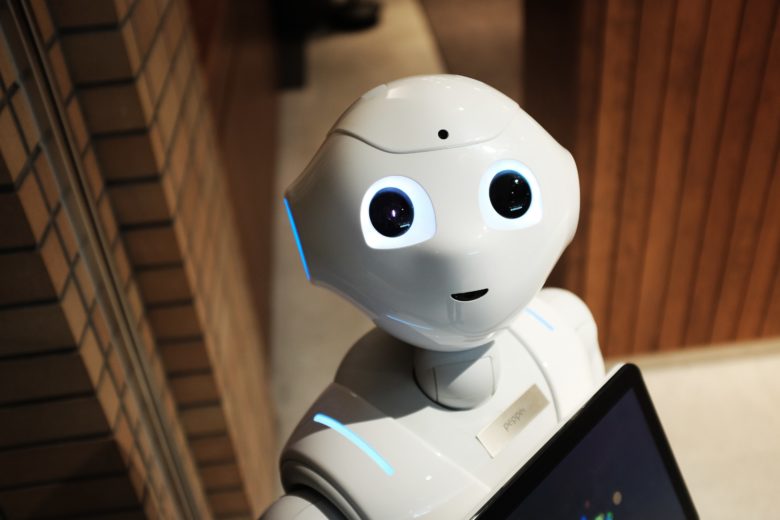

An den Begriffen „Künstliche Intelligenz (KI)“ oder „Artifical Intelligence (AI)“ geht momentan in kaum einer Branche ein Weg vorbei. Gemeint ist dabei die Erforschung „intelligenten” Problemlösungsverhaltens sowie die Erstellung „intelligenter” Computersysteme. Dabei beschäftigt sich die Künstliche Intelligenz mit Methoden, durch welche ein Computer im Stande sein soll, Aufgaben zu lösen, welche ein intelligentes Handeln vom Menschen erfordern würden. So die Definition von dem Universitätsprofessor Richard Lackes von der Technischen Universität Dortmund.

Eben diese Entwicklung von „intelligenten Computersystemen“ geht dabei im Moment rasend schnell voran. Und wird in dieser Geschwindigkeit auch gefördert. Das Europäische Parlament bezeichnet die KI als einen „wesentlichen Treiber für die digitale Transformation“ der Gesellschaft. Daher sei die KI auch eine wichtige Priorität der EU. Dabei unterscheidet die EU diese in zwei verschiedenen Arten: Software, zu welcher virtuelle Assistenten, Bildanalysesoftware, Suchmaschinen, Sprach- und Gesichtserkennungssysteme zählen und „Eingebettete“ KI, also Roboter, autonome Pkw, Drohnen, Anwendungen des „Internets der Dinge“.

Rassistische und sexistische Künstliche Intelligenz

Diese ganz verschiedenen Anwendungen begegnen den Menschen in Industriestaaten nahezu täglich. In Erscheinung treten diese dabei beispielsweise in Form von Suchmaschinen, Online-Marketing, Online-Shopping oder Algorithmen auf Social Media-Plattformen. Auch im Gesundheitswesen, im Verkehr oder in der öffentlichen Verwaltung werden die Anwendungen dabei immer präsenter. Dabei ist es in der Vergangenheit schon zu bereits unerwünschten Nebeneffekten gekommen.

Als rassistisch und sexistisch haben sich einige Anwendungen in diversen Fällen erwiesen. Dabei sind die Fehler allerdings, wie so oft, nicht bei den Maschinen selbst zu suchen, sondern bei denjenigen, welche sie konzipiert haben. Oder im Falle der Kündtlichen Intelligenz besser ausgedrückt: Trainiert haben. Ein besonders publiker Fall: In den USA wurde eine Software eingesetzt, welche Richter:innen bei der Einschätzung der Gefahr zur erneuten Straffälligkeit von vorzeitig entlassenen Insass:innen unterstützen sollte. Das Journalistennetzwerks Propublica fand dabei heraus, dass das Risiko der Rückfälligkeit bei dunkelhäutigen Häftlingen höher eingestuft wurde als bei hellhäutigen. Der Auslöser dafür konnte im vorausgegangen Training der KI und grundsätzlichen Problemen in den USA festgestellt werden. Dunkelhäutige Menschen werden in den USA häufiger verhaftet. Dadurch waren sie in den Datensätzen, mit welchen die Software trainiert wurde, überproportional vertreten.

Österreichs neue KI-Strategie kommt ohne konkrete Finanzierungspläne

Nachhaltigkeit in der KI gesucht

Dieser Fall und gleichzeitig die steigende Anzahl von KI-Anwendungen machen somit deutlich, dass es auch in dem Bereich nötig ist, die Auswirkungen von diesen immer mehr zu überwachen und zu überprüfen. Eine Forschungsgruppe hat sich da jetzt eine ganz spezielle Frage gestellt: Wie nachhaltig sind KI-Anwendungen? Dabei versuchten die Forschenden die drei Dimensionen der Nachhaltigkeit zu beleuchten: die soziale, ökologische und ökonomische Wirkung einer KI.

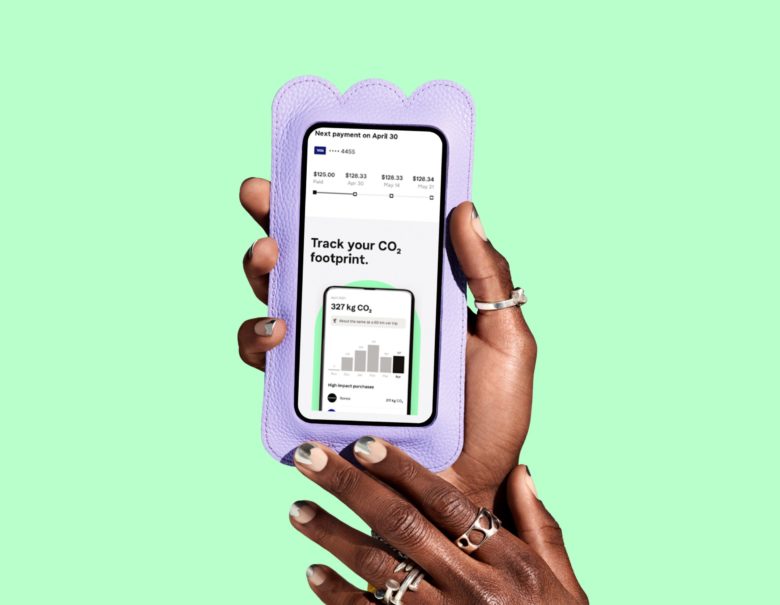

Das Forschungsteam von AlgorithmWatch, dem Institut für ökologische Wirtschaftsforschung (IÖW) und dem Distributed Artificial Intelligence Laboratory der Technischen Universität Berlin haben für die Beantwortung dieser Frage nun aktuell ein Kriterien- und Indikatorenset für nachhaltige KI entwickelt. Dabei beziehen sie sich auf über 50 Indikatoren, welche die soziale, ökologische und ökonomische Nachhaltigkeit von Systemen mit Künstlicher Intelligenz beweisbar und vergleichbar machen soll. Dafür haben die Forschenden die Nachhaltigkeitseffekte entlang des Lebenszyklus der KI analysiert, sowohl vom Datenmodell und Systemdesign, über die Modellentwicklung und -nutzung bis hin zur Entsorgung der Hardware, so die aktuellen Angaben dazu.

Die Kriterien sind dabei ganz unterschiedlich. Einige Beispiele sind Indikatoren wie ‚Transparenz‘, ‚Selbstbestimmung‘, ‚inklusives Design‘ und ‚kulturelle Sensibilität‘ zur Beurteilung der sozialen Auswirkungen, ‚Ressourcenverbräuche‘ und ‚Treibhausgasemissionen‘ für die ökologischen Auswirkungen und ‚Verteilungswirkungen in Zielmärkten‘ für die Beurteilung der ökonomischen Relevanz. „Derzeit wird unter den Schlagworten ‚AI for Earth‘ oder ‚AI for Good‘ viel darüber gesprochen, wie Künstliche Intelligenz eingesetzt werden kann, um zu einer nachhaltigen Entwicklung beizutragen“, so die Soziologin und Studienautorin Friederike Rohde, „Die Nachhaltigkeitswirkungen der KI-Systeme selbst werden hingegen nicht systematisch betrachtet. Dabei ist das hochrelevant, um ein Bewusstsein für Nachhaltigkeitsrisiken zu schaffen und diese zu minimieren.“ Die von den Forschenden nun entwickelten Kriterien und Indikatoren soll daher für die Entwicklung von „konkreten Bewertungsinstrumente“ verwendet werden, so die Hoffnung des Teams.

Satelliten und KI haben bisher unbekannte Solaranlagen entdeckt

UNESCO bringt Empfehlung für ethische KI heraus

Mit ihrer Studie arbeiten die Forschenden ein Thema auf, welches nicht nur im wissenschaftlichen Kontext, sondern auch im politischen aktueller ist denn je. Vor wenigen Wochen, am 23. November 2021, haben die 193 Mitgliedstaaten der UNESCO mit der Empfehlung zur Ethik Künstlicher Intelligenz (KI) den ersten global verhandelten Völkerrechtstext in dem Bereich verabschiedet. Diesem gingen zwei Jahre Verhandlungen voraus. Dieser globale „Referenzrahmen für eine ethische Nutzung von KI“ beinhaltet laut der UNESCO „ethische Leitplanken“, welche in „politische Gestaltungsaufgaben“ übersetzt seien. Damit sollen die Menschen- und Grundrechte bei dem Einsatz von KI-Anwendungen geschützt und explizit gefördert werden.

Neben konkreten politischen Handlungsempfehlungen empfiehlt die UNESO außerdem, den Einsatz eines Ethical Impact Assessments für KI-Systeme, mit welchem die Vorteile und Risiken von bestimmten KI-Systemen für die Wahrung von Menschenrechten und Grundfreiheiten über deren gesamten Lebenszyklus erfasst und bewertet werden sollen. Außerdem soll auch die Diversität in der Technologiebranche unterstützt werden und Stereotypisierung in den Ergebnissen von KI-Systemen und -Daten durch Mitgliedstaaten offengelegt und bekämpft werden. Im Bereich der ökologischen Nachhaltigkeit empfiehlt die UNESCO „insbesondere“ den nachhaltigen und ressourcenschonenden Einsatz von KI-Systemen.

Menschen sind oft gemeiner zu KI und Robotern als zu Menschen

Die 193 Mitgliedsstaaten sind nun angehalten, diese KI-Ethik-Empfehlung der UNESCO für die Entwicklung nationaler KI-Maßnahmen zu nutzen und mit einzubeziehen. In welcher Form diese von den einzelnen Staaten dann also tatsächlich Anwendung findet, wird sich zeigen. Insbesondere im ethischen Bereich gibt es auf internationaler Ebene deutlich unterschiedliche Auffassungen zu der Anwendung von KI-Systemen. Nachdem diese aber nicht mehr aus der Zukunft wegzudenken sind, sind solche Überlegungen und Vorgaben elementar um die Künstliche Intelligenz in das gesellschaftliche Leben nachhaltig einzuflechten. Und zwar in einer Form, für welche sie eigentlich konzipiert worden sind: Zur Durchführung intelligenter Handlungen. Nicht, um gegenteiliges Verhalten zu unterstützen.