Meta launcht erste Llama-4-Modelle, schlägt OpenAIs GPT-4.5 und Grok-3 von xAI

Meta hat überraschend am Samstag Abend die ersten Modelle seiner neuen Llama 4 Serie vorgestellt. Die neuen KI-Modelle sollen sich durch eine native Multimodalität und eine Mixture-of-Experts (MoE) Architektur auszeichnen, die signifikante Leistungsverbesserungen gegenüber Vorgängerversionen und Konkurrenzprodukten bieten soll.

Anders als die direkte Konkurrenz von OpenAI (GPTs), Google (Gemini), Anthropic (Claude) oder xAI (Grok) sind die Llama-4-Modelle nicht proprietär, sondern können unter Meta-Lizenz kostenlos geladen und verwendet werden. Meta gibt bei der kommerziellen Nutzung Einschränkungen vor. Die Wichtigste: Services mit mehr als 700 Mio. Usern müssen eine Sonderlizenz von Meta erhalten – so soll vermieden werden, dass Konkurrenten sich der Llama-Modelle bedienen.

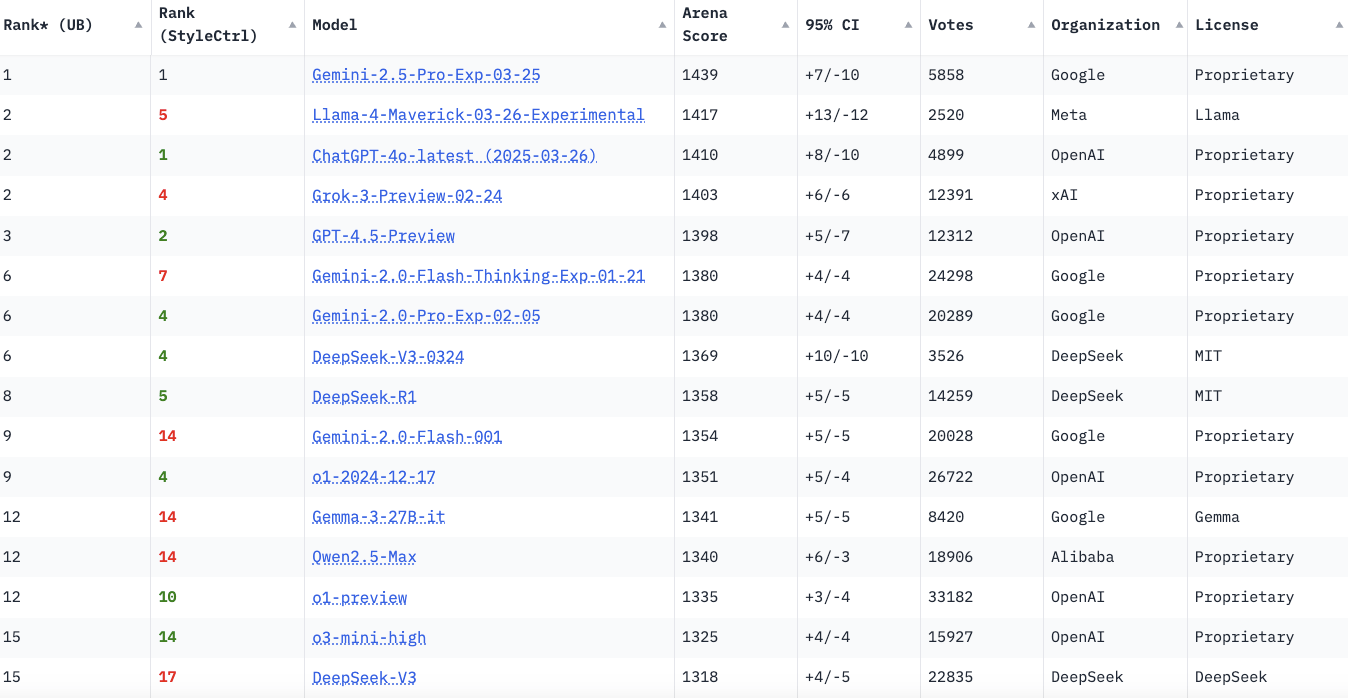

In der Ankündigung vergleicht Meta seine neuen Llama-Modelle vor allem mit GPT-4o von OpenAI, Gemini 2.0 Flash von Google und DeepSeek V3.1, aber nicht mit den aktuellen Top-Modellen der Konkurrenz (Grok-3 von xAI, GPT-4.5 und Gemini 2.5 Pro). Das bedeutet aber nicht, dass Meta bereits zum Release eingesteht, dass es derzeit nicht mit der Spitzenklasse mithalten kann. Im Ranking der Chatbot Arena liegt Llama 4 Maverick am Samstag Abend bereits auf Platz 2:

Die neuen Modelle im Detail

Llama 4 Scout mit 10 Millionen Token Kontextfenster

Das Llama 4 Scout verfügt über 17 Milliarden aktive Parameter mit 16 Experten und insgesamt 109 Milliarden Parameter. Besonders bemerkenswert ist die Erweiterung des Kontextfensters von 128.000 Tokens bei Llama 3 auf nun 10 Millionen Tokens – ein Industrierekord. Diese Verbesserung ermöglicht komplexe Anwendungen wie Multi-Dokument-Zusammenfassungen und das Verarbeiten umfangreicher Codebasen. Laut Meta übertrifft das Modell vergleichbare Konkurrenzprodukte wie Gemma 3, Gemini 2.0 Flash-Lite und Mistral 3.1 in verschiedenen Benchmarks.

Llama 4 Maverick soll besser als GPT-4o sein

Das leistungsstärkere Llama 4 Maverick nutzt ebenfalls 17 Milliarden aktive Parameter, verfügt jedoch über 128 Experten und insgesamt 400 Milliarden Parameter. Meta positioniert dieses Modell als Allzweck-Chat-Modell mit herausragenden Fähigkeiten im Bildverständnis und kreativen Schreiben. In Benchmarks soll es GPT-4o und Gemini 2.0 Flash in Bereichen wie Programmierung, logisches Denken, Mehrsprachigkeit und Bildverarbeitung übertreffen und mit dem deutlich größeren DeepSeek v3.1 konkurrieren können.

Llama 4 Behemoth

Als drittes Modell wurde Llama 4 Behemoth vorgestellt, das mit 288 Milliarden aktiven Parametern, 16 Experten und fast zwei Billionen Gesamtparametern als Lehrer-Modell für die kleineren Varianten dient. Meta gibt an, dass dieses Modell GPT-4.5, Claude Sonnet 3.7 und Gemini 2.0 Pro in STEM-Benchmarks übertrifft. Llama 4 Behemoth wird derzeit noch trainiert und ist nicht für die Öffentlichkeit verfügbar.

Technische Innovationen

Mixture-of-Experts Architektur

Die Llama 4 Modelle sind Metas erste Implementierung der MoE-Architektur. Bei diesem Ansatz aktiviert ein einzelnes Token nur einen Bruchteil der Gesamtparameter, was die Recheneffizienz beim Training und bei der Inferenz verbessert. Meta verwendet alternierende dichte und MoE-Schichten, wobei jedes Token zum gemeinsamen Experten und zu einem von 128 spezialisierten Experten geleitet wird.

Native Multimodalität

Im Gegensatz zu früheren Modellen wurden die Llama 4 Modelle von Grund auf multimodal konzipiert. Sie nutzen eine frühe Fusion, um Text- und Bildtokens nahtlos in ein einheitliches Modell-Backbone zu integrieren. Dies ermöglicht ein gemeinsames Vortraining mit großen Mengen an unmarkierten Text-, Bild- und Videodaten.

Kontextfenster und Architektur

Eine Schlüsselinnovation ist die iRoPE-Architektur (interleaved Rotary Position Embeddings), die verschachtelte Aufmerksamkeitsschichten ohne Positionseinbettungen verwendet. Dies ermöglicht die beeindruckende Kontextfenstergröße von 10 Millionen Tokens bei Llama 4 Scout.

Leistungsvergleich zur Konkurrenz

In den von Meta durchgeführten Benchmarks zeigen die neuen Modelle folgende Stärken:

-

Llama 4 Scout übertrifft vergleichbare Modelle bei der Bildverankerung und ermöglicht präzisere visuelle Frage-Antwort-Interaktionen

-

Llama 4 Maverick erreicht bessere Ergebnisse als GPT-4o und Gemini 2.0 in Programmierung, logischem Denken und Bildverständnis

-

Llama 4 Behemoth übertrifft GPT-4.5, Claude Sonnet 3.7 und Gemini 2.0 Pro in STEM-fokussierten Benchmarks wie MATH-500 und GPQA Diamond1

Die Modelle wurden mit über 30 Billionen Tokens trainiert – mehr als doppelt so viele wie bei Llama 3 – und unterstützen 200 Sprachen, wobei über 100 Sprachen mit jeweils mehr als einer Milliarde Tokens trainiert wurden.

Verfügbarkeit

Llama 4 Scout und Llama 4 Maverick sind ab sofort auf llama.com und Hugging Face zum Download verfügbar. Meta AI mit Llama 4 kann in WhatsApp, Messenger, Instagram Direct und auf der Meta.AI-Website getestet werden.