Nobelpreis für Physik 2024 geht an zwei KI-Grundlagenforscher

Der diesjährige Nobelpreis für Physik geht an John J. Hopfield von der Princeton University in New Jersey und Geoffrey E. Hinton von der University of Toronto. Die beiden wurden “für ihre grundlegenden Entdeckungen und Erfindungen, die maschinelles Lernen mit künstlichen neuronalen Netzen ermöglichen“, ausgezeichnet.

Grundlage für maschinelles Lernen geschaffen

Sowohl Hopfield als auch Hinton haben seit den 1980er Jahren bedeutende Arbeiten mit künstlichen neuronalen Netzen durchgeführt. Sie nutzten dabei Werkzeuge aus der Physik, um Methoden zu entwickeln, die dazu beitrugen, die Grundlage für das heutige leistungsstarke maschinelle Lernen zu schaffen.

Hopfield: „Methode zur Speicherung und Wiederherstellung von Mustern“

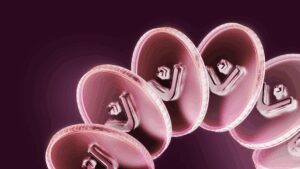

Der 1933 in Chicago geborene John J. Hopfield entwickelte das sogenannte Hopfield-Netzwerk, einen Assoziativspeicher, der Bilder und andere Arten von Mustern in Daten speichern und rekonstruieren kann. Dabei nutzt das Netzwerk die Physik, denn damit lassen sich die Eigenschaften eines Materials aufgrund seines atomaren Spins beschreiben – eine quantenmechanische Eigenschaft von Atomkernen und Elektronen, die jedes Atom zu einem winzigen Magneten macht.

Das Netzwerk besteht aus Knoten, die sich gegenseitig beeinflussen, um den Energiezustand zu minimieren – ihnen wurde jeweils ein individueller Wert von 0 oder 1 zugewiesen. Wird ein unvollständiges Bild eingespeist, arbeitet das Netzwerk schrittweise die Knoten ab, passt ihre Werte an und nähert sich dem originalen Bild an, indem es die Energie reduziert.

Hintons Boltzmann-Maschine erkennt charakteristische Elemente in Daten

Der 1947 in London geborene und in Kanada lebende Geoffrey E. Hinton baute auf der Arbeit von Hopfield auf und leitete damit die explosionsartige Entwicklung des maschinellen Lernens ein, wie die “Royal Swedish Academy of Sciences“, die den Nobelpreis vergibt, betont. Hintons Methode spielte eine entscheidende Rolle bei den heute genutzten großen künstlichen neuronalen Netzen für maschinelles Lernen.

Auf Basis des Hopfield-Netzwerks entwickelte der britisch-kanadische Wissenschaftler die Boltzmann-Maschine, ein neues Netzwerk mit einer anderen Methode. Diese ist auf das Training ausgelegt und lernt, charakteristische Elemente in einer bestimmten Art von Daten zu erkennen.

Die Maschine wird mit Beispielen gefüttert, die typischerweise in den analysierten Daten vorkommen. Diese helfen der Boltzmann-Maschine, mit hoher Wahrscheinlichkeit zu lernen, wie sie Muster erkennt und die Daten korrekt klassifiziert. Für seine Forschung nutzte Hinton Werkzeuge aus der statistischen Physik.

Österreichs „KI-Strategie“ stammt noch aus der Zeit vor ChatGPT