NXAI: Linzer AI-Startup kündigt AI-Modell mit 7 Milliarden Parametern an

Angekündigt haben sie es schon, ein kompetitives AI-Modell, das es mit den am Markt gängigen Transformer-Modellen aufnehmen oder diese sogar überbieten kann. Nun hat NXAI das, was CEO Albert Ortig bereits im Interview mit Trending Topics ankündigte, noch einmal untermauert. „Insbesondere die Einführung des 7B-Modells, eines neuen 7-Milliarden-Parameter-Modells basierend auf der xLSTM-Technologie, wird die europäische Wettbewerbsfähigkeit im KI-Bereich signifikant steigern“, heißt es in einer aktuellen Bekanntmachung.

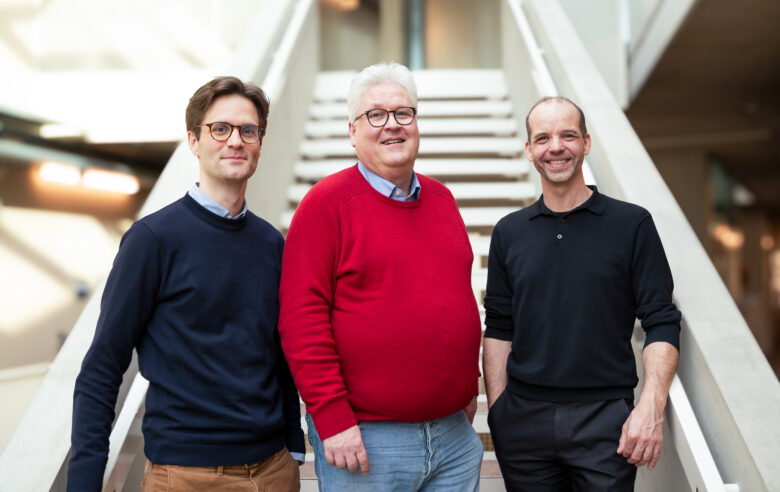

xLSTM ist die Weiterentwicklung des alten „Long Short-Term Memory“-Modells, das AI-Forscher Sepp Hochreiter mit entwarf und das in der Vergangenheit unter anderem Sprachassistenten der ersten Generation wie Apples Siri oder Amazons Alexa unterstützte. Durch die Veröffentlichung der Transformer-Technologie durch Google wurden diese zum Standard, das „T“ in ChatGPT steht für diese Transformer. Nun hat sich das Ende 2023 gegründete Linzer Startup NXAI rund um Hochreiter und Ortig angeschickt, wiederum die Transformer mit xLSTM zu überholen.

Geplant ist also ein AI-Modell auf Basis von „extended LSTM“ mit 7 Milliarden Parametern. Damit wird es ein eher kleines AI-Modell. Der Aussendung zufolge soll das Modell hohe Leistungsfähigkeit und Effizienz an den Tag legen und durch die Integration „fortschrittlicher Gedächtniskonzepte“ eine Vielzahl von Anwendungen in verschiedenen Industriezweigen ermöglicht. Damit ist klar, was Ortig und Hochreiter vorschwebt: Sie wollen keinen direkten ChatGPT-Rivalen, der von Schule bis Arbeitsplatz Einsatz findet, sondern vor allem industrielle Anwendungszecke finden.

NXAI-CEO Albert Ortig: „Werden dieses Jahr erstes kompetitives AI-Modell launchen“

„Der Open Source-Weg wird wirtschaftlich schwer funktionieren“

Mit 7 Milliarden Parametern wird sich das AI-Modell aus Linz, rein den Zahlen nach, mit mehreren bereits am Markt befindlichen AI-Modellen ähnlicher Größenordnung direkt messen müssen, unter anderem:

- Mistral 7B

- Gemma 7B von Google

- Llama 3 8B von Meta Platforms

- DCLM-7B von Apple

Open Source wird das neue Modell voraussichtlich nicht sein. „Es ist recht klar, dass der Open Source-Weg in der KI-Modellperspektive wirtschaftlich schwer funktionieren wird. Das leistet sich Apple und das leistet sich Meta. Alle anderen haben zugemacht“, sagte Ortig im Interview. „Apple launcht ein Modell, damit sie diese ganze Entwickler-Community onboarden. Man wird nicht drumherum kommen, Spielplätze zur Verfügung zu stellen. Das haben wir auch schon gemacht. Das werden wir auch weiterhin tun, aber wir werden, so wie es jetzt aussieht, nicht den Open Source-Weg bestreiten.“

Neben dem 7B-Modell fokussiert man sich bei NXAI außerdem stark auf den Bereich der Simulationen. Angekündigt wurde auch ein neues wissenschaftliches Paper zu Partikelsimulationen sowie ein Simulation-Foundation-Modell. Klar ist, dass NXAI verstärkt die Öffentlichkeit sucht, immerhin ist noch für dieses Jahr eine große Finanzierungsrunde geplant, um in Forscher:innen, Team und vor allem Rechenleistung investieren zu können.