xAI: Frontalangriff auf OpenAI – Grok-3 soll alle anderen AI-Modelle schlagen

Vier weiße Männer zusammengedrängt um einen runden Tisch: Schon alleine das Setting der Präsentation von xAI’s neuestem AI-Modell Grok 3 stellt das kleine Studio nach, von dem aus der große Konkurrent OpenAI seine Neuerungen in die Welt bläst. Bei xAI, dem AI-Startup von Elon Musk, geht es letztendlich diesmal darum, zu zeigen: Wir sind besser, schneller und größer als OpenAI von Musks Erzrivalen Sam Altman.

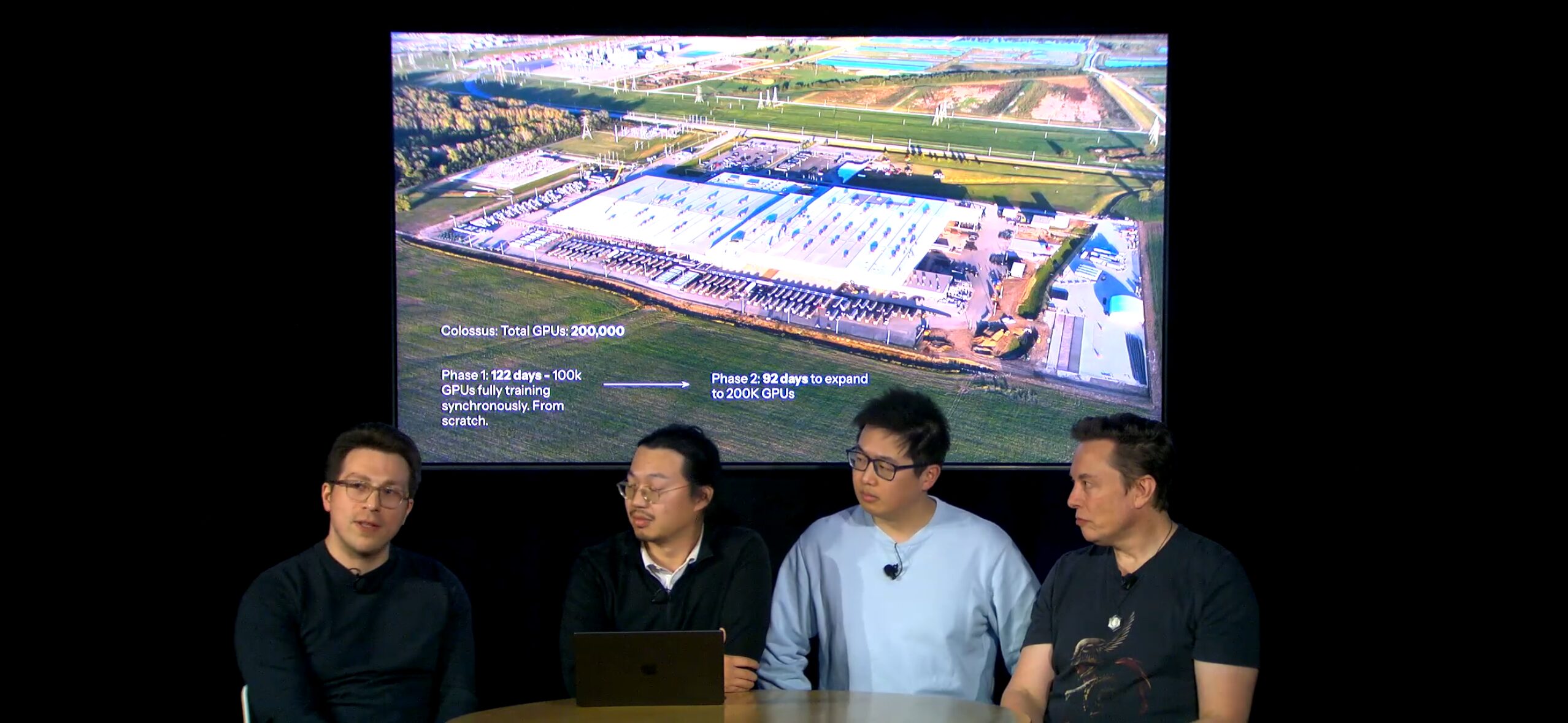

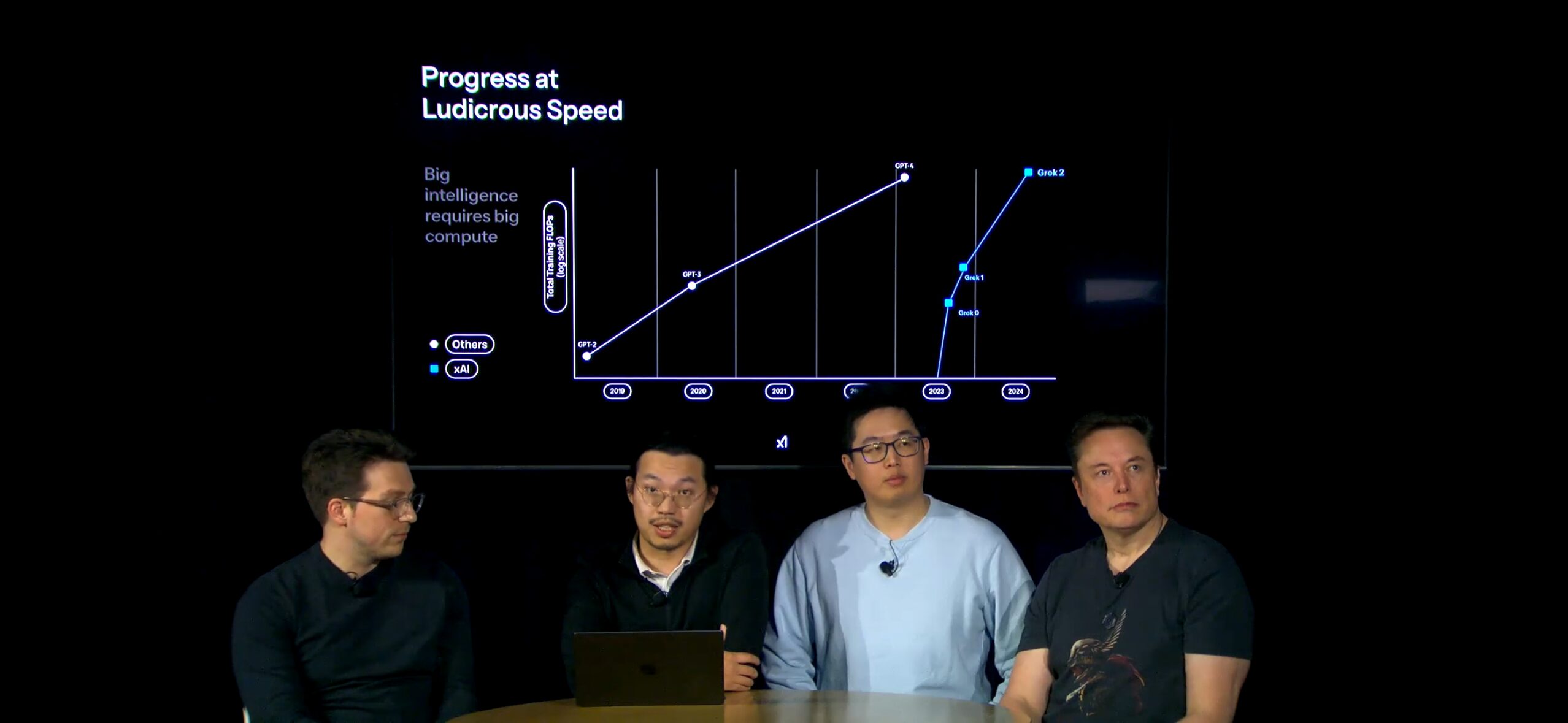

Aber konkret zu Grok 3. Das neueste AI-Modell wurde im hauseigenen Rechenzentrum „Colossus“ mit Hilfe von dort mittlerweile 200.000 installierten H100-GPUs von Nvidia trainiert – es soll das größte AI-Rechenzentrum dieser Art der Welt sein, und nur damit hätte man es geschafft, so schnell zu OpenAI aufzuholen, das sich ja bisher vor allem den Azure-Rechenzentren von Microsoft bediente. Hier einige Punkte, die bekannt gegeben wurde:

Modellfamilie und Varianten:

- Grok-3 ist eine Familie von KI-Modellen, die verschiedene Varianten umfasst

- Eine kompaktere Version „Grok-3 mini“ bietet schnellere Antworten bei etwas geringerer Genauigkeit

- Spezielle „Reasoning“-Varianten (Grok-3 Reasoning und Grok-3 mini Reasoning) für komplexe Problemlösungen

Technische Basis:

- Training erfolgte mit etwa 200.000 GPUs in einem Rechenzentrum in Memphis

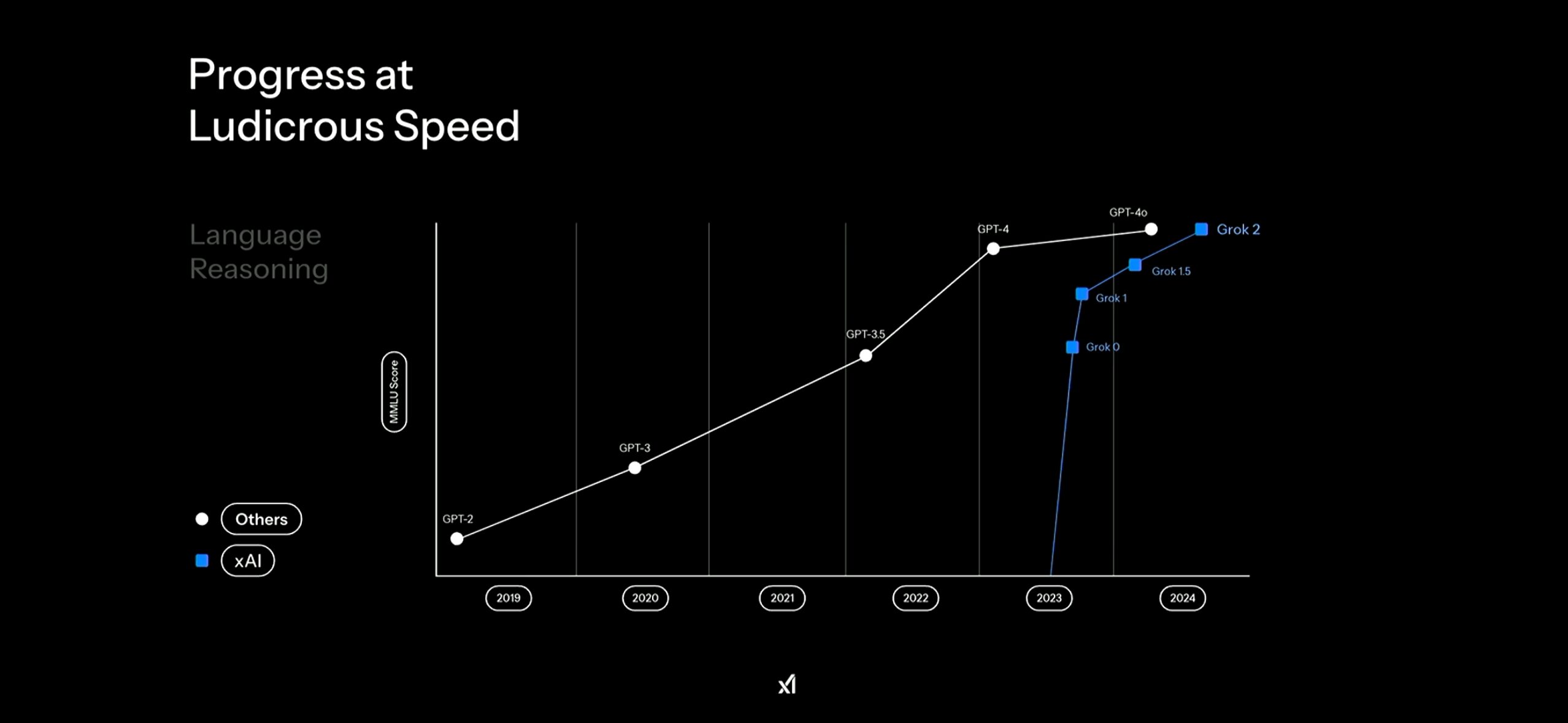

- Laut Entwickler wurde die 10-fache Rechenleistung im Vergleich zum Vorgänger Grok-2 eingesetzt

- Erweiterter Trainingsdatensatz, der auch Gerichtsakten einschließt

Leistungsfähigkeit:

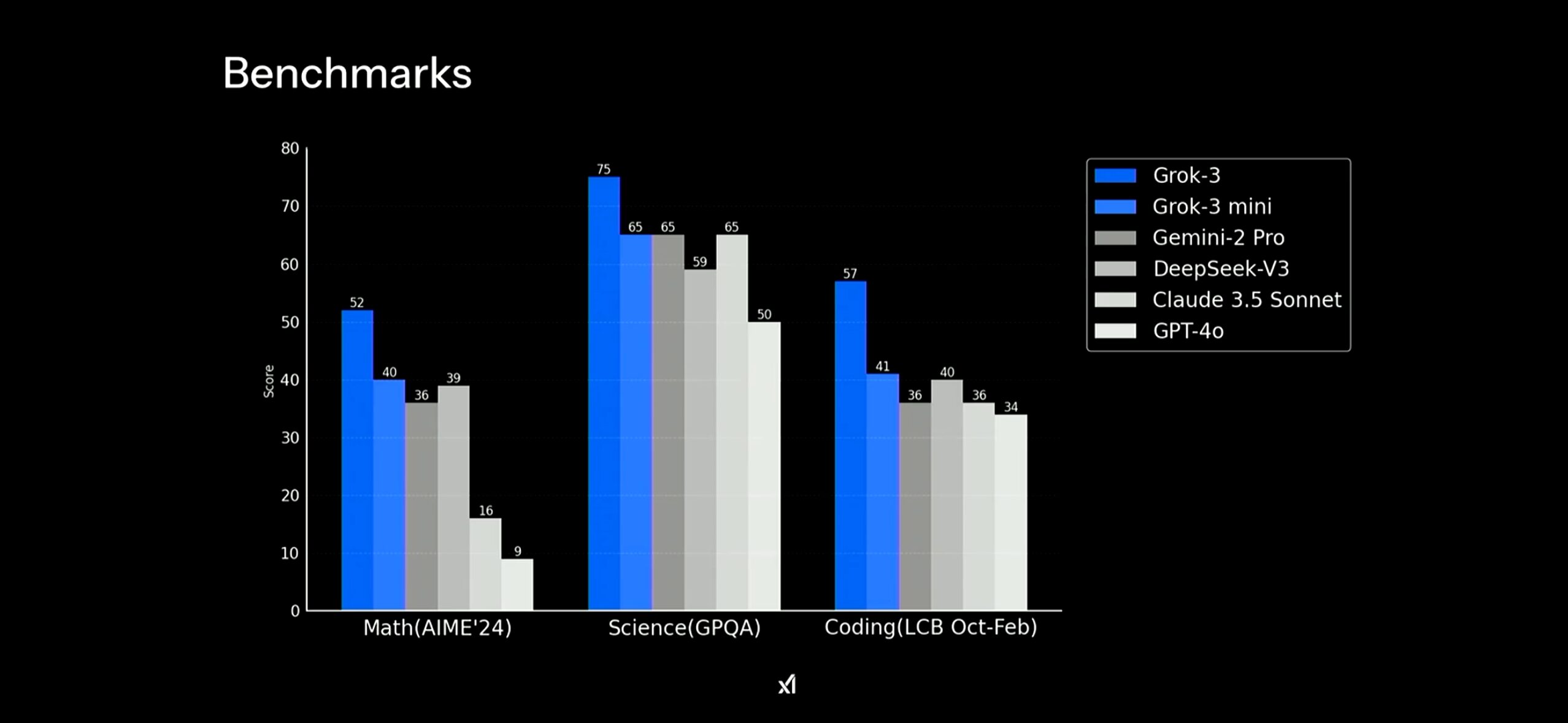

- Übertrifft nach Herstellerangaben GPT-4o in verschiedenen Benchmarks

- Besonders gute Ergebnisse in mathematischen (AIME) und naturwissenschaftlichen Tests (GPQA)

- Competitive Ergebnisse im crowdbasierten Chatbot Arena Test

Neue Funktionen:

- „Think“-Modus für selbstständiges Durchdenken von Problemen

- „Big Brain“-Modus für besonders rechenintensive Aufgaben

- DeepSearch-Funktion zur Analyse von Internet- und X-Inhalten

- Geplante Sprachausgabe-Funktion

- Bildanalyse-Fähigkeiten

Verfügbarkeit und Zugang:

- Zunächst für X Premium+ Abonnenten ($22/Monat)

- Erweiterte Funktionen im SuperGrok-Abo ($30/Monat oder $300/Jahr)

- Enterprise API-Zugang in Planung

- Vorgängerversion Grok-2 soll nach vollständiger Etablierung von Grok-3 als Open Source verfügbar werden

Grok-3 soll Gemini 2 Pro, GPT-4o, DeepSeek V3 und Claude 3.5 Sonnet überbieten

Musk wäre auch nicht Musk, wenn er bei der Präsentation nicht die Superlative auspacken würde. Und so wird Grok-3 gleich mal an die SPitze der LLMs gestellt. In eigenen Benchmarks würde das Modell alle anderen bisher verfügbaren Topmodelle von Google (Gemini 2 Pro), OpenAI (GPT-4o), DeepSeek (V3) und Anthropic (Claude 3.5 Sonnet) übertreffen können, insbesondere in den Bereichen Mathematik, Naturwissenschaften und Coding.

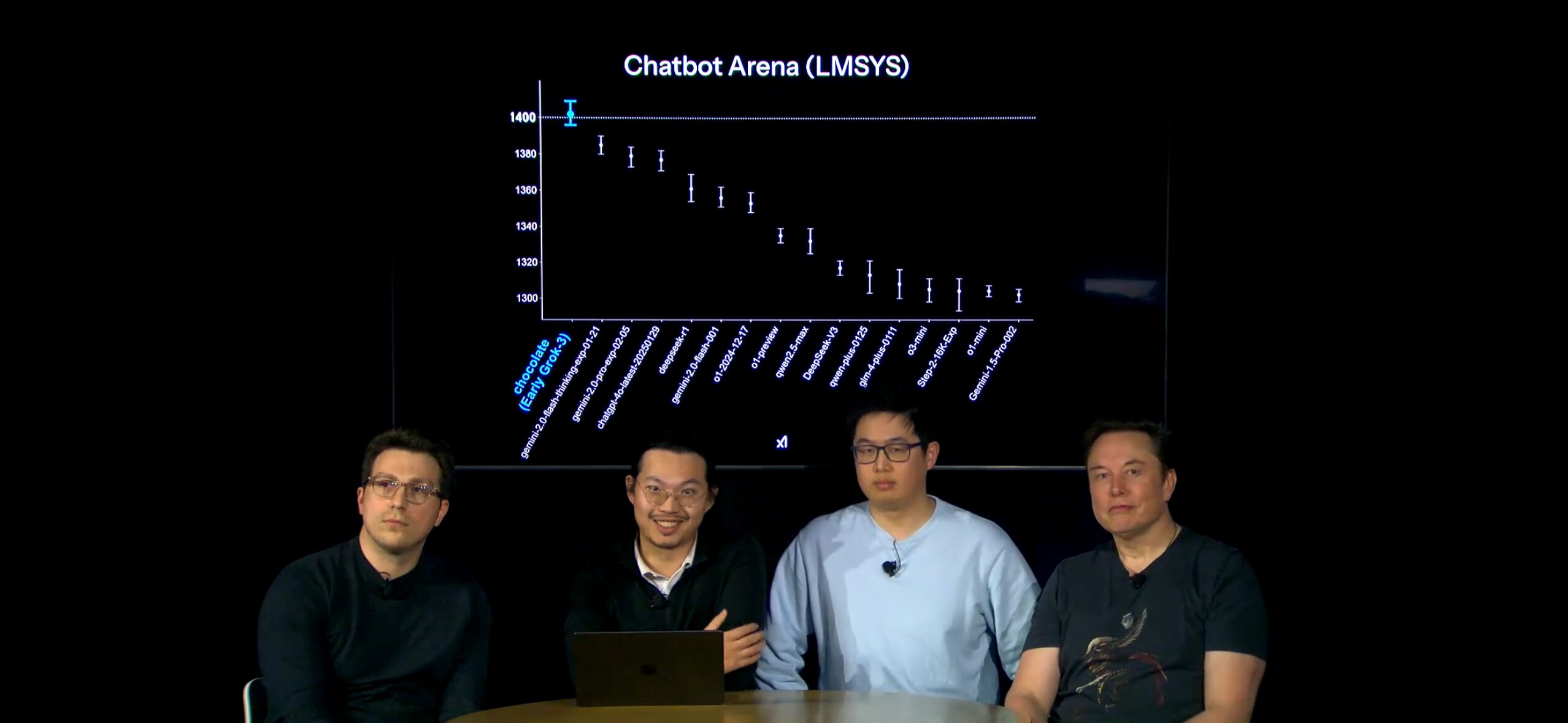

Aber auch durch externe Quellen will man die Leistungsfähigkeit bestätigt haben, und zwar durch einen Blindtest in der für die Branche sehr wichtigen Chatbot Arena. Dort soll Grok-3 unter dem Codenamen „chocolate“ erstmals um die 1.400 Punkte erreicht haben, also durch Tester:innen besser bewertet worden sein als Google, OpenAI, DeepSeek und Co.

Hartes Wettrennen um die Vorherrschaft

Das Wettrennen um immer bessere AI-Modelle ist hart und verschlingt Milliarden. xAI alleine hat 2024 12 Milliarden Dollar Risikokapital aufgenommen und soll derzeit dabei sein, noch einmal 10 Milliarden Dollar bei einer Bewertung von 75 Milliarden Dollar aufnehmen zu wollen. OpenAI hat 2024 bereits mehr als zehn Milliarden Dollar an Eigen- und Fremdkapital geholt, während die Hyperscaler Microsoft, Meta, Google und Amazon insgesamt 300 Milliarden Dollar für AI und die dazu notwendige Infrastruktur 2025 ausgeben zu wollen.

Musk, engster Berater von Donald Trump, schoss zuletzt scharf gegen OpenAI – und zwar nicht nur gegen dessen 500 Milliarden Dollar schweres „Stargate“-Projekt, sondern auch mit einem Übernahmeversuch von etwa 100 Milliarden Dollar von OpenAI. Der wurde abgelehnt, brachte aber natürlich zusätzliche Unruhe ins Unternehmen.

OpenAI-CEO Sam Altman hat angekündigt, dass GPT-5 in den nächsten Monaten, GPT-4.5 in den nächsten Wochen veröffentlicht wird. von Anthropic ist demnächst Claude 4 zu erwarten, Google wird spätestens auf seiner Hauskonferenz I/O am 20. und 21. Mai nachlegen – und Startups wie DeepSeek sind auch immer für eine Überraschung gut. Es bleibt spannend.

OpenAI kündigt GPT-5 an – massiver Druck auf dem größten AI-Startup