XUND startet AI-Assistenten: „Haben uns für Open-Source-Modell von Mistral AI entschieden“

Sie haben erst kürzlich eine Erweiterung der letzten Finanzierungsrunde um 2 Mio. Euro bekannt gegeben, um ein eigenes medizinisches AI-Tool zu entwickeln – und heute können sie es bereits präsentieren. Das Wiener HealthTech-Startup XUND rund um Mitgründer und CEO

Trending Topics: Was ist der Vorteil der neuen AI-Lösung?

: Modelle wie ChatGPT sind mit zwei großen Herausforderungen konfrontiert. Erstens sind sie Black Boxes, geschlossene Systeme, die keinen Einblick in ihre Architektur, ihren Quellcode oder die verwendeten Trainingsdaten erlauben. Zweitens sind diese Modelle per Design immer Generalisten, die bei tiefem Expertenwissen an ihre Grenzen stoßen, was ihre Anwendbarkeit in spezialisierten Bereichen wie der Medizin stark einschränkt.

Unser Ansatz ist es daher, diesen Generalisten zu einem Spezialisten zu trainieren. Dabei setzen wir auf 2 Techniken: Retrieval Augmented Generation (RAG) und Direct Preference Optimization (DPO). RAG kombiniert das natürliche Sprachverständnis von LLMs mit der Fähigkeit, spezifische Informationen aus großen Datenmengen gezielt zu extrahieren. Dies führt zu einer deutlich verbesserten Genauigkeit und Relevanz der generierten Inhalte im medizinischen Kontext. Durch DPO können Modelle dann direkt auf spezifische Präferenzen trainiert und die Vorhersagen sowie die Sprachqualität des Modells weiter optimiert werden. Im medizinischen Bereich kann dies dazu beitragen, dass die generierten Inhalte genauer auf die individuellen Bedürfnisse der Nutzer zugeschnitten sind.

Wie kommt ihr mit dem Tool in die Krankenhäuser bzw. zu den Ärzten?

Wir haben bereits seit 2020 eine Kooperation mit der Thieme Gruppe. Bisher lag der Schwerpunkt auf der Bereitstellung von verlässlichen Informationen zu Krankheitsbildern in patientengerechter Sprache für unsere Medizinprodukte. Im Rahmen unserer kürzlich bekannt gegebenen Erweiterung der Seed-Finanzierungsrunde auf insgesamt 8 Millionen Euro hat sich die Thieme Gruppe nun auch an XUND beteiligt. Mit dieser Beteiligung wollen wir unsere bereits bestehende Zusammenarbeit weiter ausbauen und noch intensiver als bisher gemeinsam an digitalen Gesundheitsinnovationen arbeiten, die Menschen im Umgang mit ihrer Krankheit unterstützen und die Arzt-Patienten-Kommunikation verbessern.

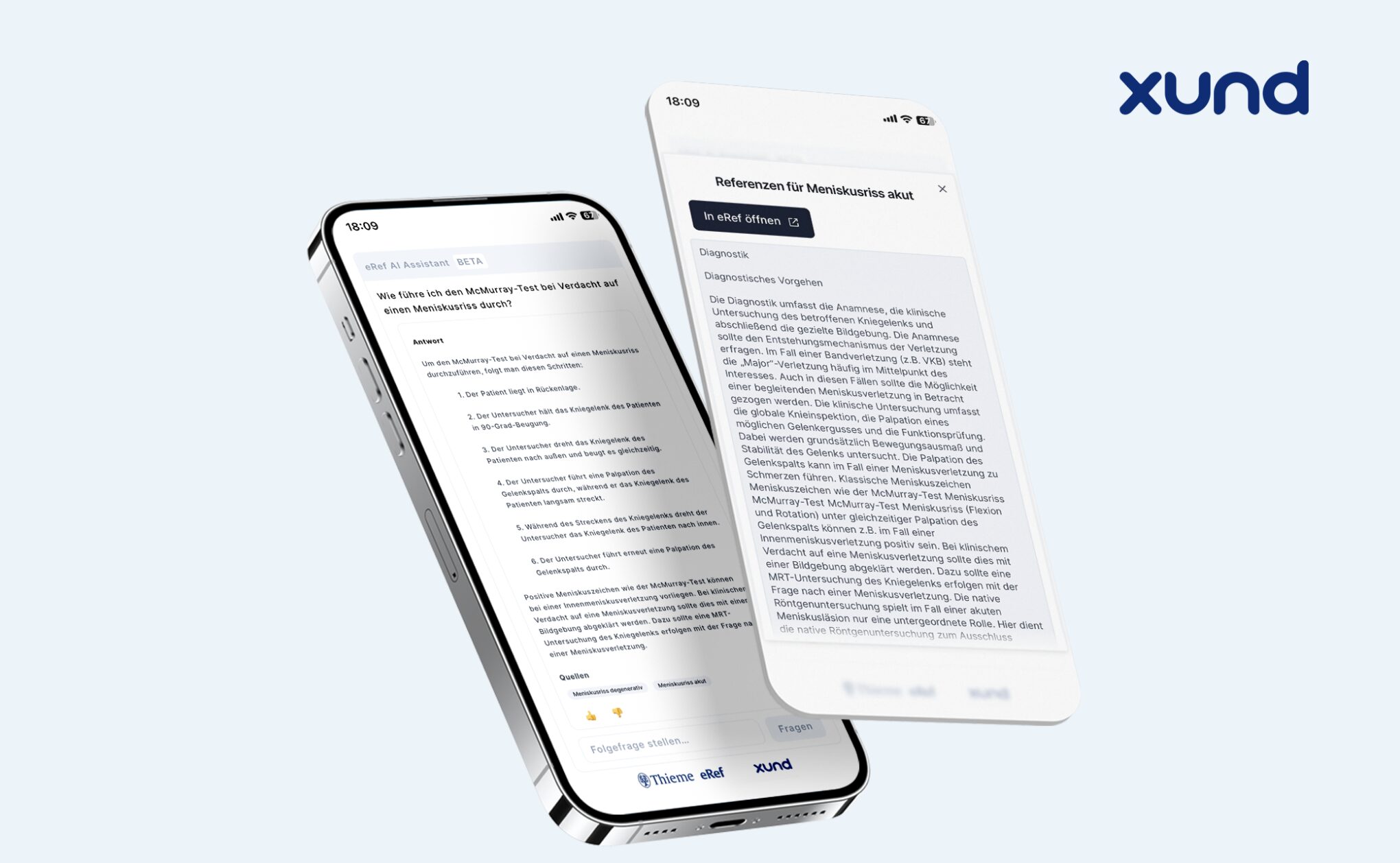

Das erste gemeinsame Produkt das wir Anfang April bereits auf der DMEA vorgestellt haben ist der eRef AI Assistant. Wir liefern die Basistechnologie, Thieme den Zugang zu seiner Wissensdatenbank. Das Produkt wird als erstes auch in eines der Kernprodukte von Thieme integriert, nämlich in die klinische Wissensplattform eRef. Mit dem eRef AI Assistant wollen wir das leistungsfähigste Medical Large Language Model (MedLLM) im deutschsprachigen Raum bauen, das langfristig allen Nutzer:innen von eRef bzw. in 9 von 10 Krankenhäusern im DACH-Raum zur Verfügung stehen soll. Zu einem späteren Zeitpunkt ist geplant, das Produkt auch als eigenständiges Angebot auf den Markt zu bringen.

Xund: Wiener HealthTech holt 2 Mio. Euro für Entwicklung eines medizinischen AI-Modells

Wie setzen Ärzt:innen das Tool ein? Am Tablet z.B.?

Die Wissensplattform eRef ist sowohl für mobile als auch für Desktop-Anwendungen zugänglich, wird aber in der bisherigen Form von den Mediziner:innen im klinischen Alltag vor allem am Desktop genutzt. Die Möglichkeiten von MedLLMs sind jedoch vielfältig und erweitern natürlich das Spektrum der Anwendungsfelder. Wir sind gerade dabei, in eine Beta-Phase zu gehen, wo es vor allem auch darum geht, Feedback und Präferenzen von den Nutzer:innen zu sammeln. Das wird für uns die Grundlage dafür sein, in welche Richtung wir den eRef AI Assistant bzw. unsere MedLLMs weiterentwickeln. Möglicherweise werden wir sehen, dass es langfristig auch in Richtung Speech-to-Text (S2T) gehen muss, also dass die Dateneingabe der Mediziner:innen auch sprachlich erfolgen kann, was aus technologischer Sicht natürlich auch ein sehr spannendes Thema ist.

Warum habt ihr euch für Mistral entschieden bzw. welches Modell verwendet ihr konkret?

Obwohl wir nicht an Mistral gebunden sind, haben wir uns bei der Entwicklung des eRef AI Assistant bewusst für ein Open-Source-Modell entschieden, das wir selbst hosten und nach unseren Bedürfnissen weiterentwickeln können. Derzeit entspricht das Mixtral-Modell unseren Anforderungen am besten. Mit seinen 45B Parametern ist es leistungsfähiger als vergleichbare 70B-Modelle. Ein weiterer wichtiger Faktor ist die Mehrsprachigkeit. Wir haben festgestellt, dass Mixtral zum Beispiel in unseren priorisierten Sprachen (Deutsch, Englisch, Ungarisch) besser funktioniert als andere Modelle. Natürlich verfolgen wir die Entwicklungen der Open-Source-Modelle (z.B. Llama 3) auf dem Markt, aber im Moment funktioniert Mixtral 8x7b am besten für unseren Use Case.

Wie sieht das Business Modell aus, wer zahlt für die Nutzung?

Wir befinden uns noch am Anfang der Entwicklung und starten, wie bereits erwähnt, gerade in eine Beta-Phase, die neben produktspezifischem Feedback auch dazu dienen soll, die Zahlungsbereitschaft der Mediziner:innen zu ermitteln. In der weiteren Entwicklung ist es sehr wahrscheinlich, dass wir auf Lizenzmodelle setzen werden, um eine nachhaltige Monetarisierung sicherzustellen.

Gesundheitsdaten und der Health-Bereich sind Datenschutztechnisch sensibel – wie geht ihr mit dem Thema um?

Das gemeinsame Produkt mit Thieme, der eRef AI Assistant, ist heute eine intelligente Wissenssuche und keine Entscheidungsunterstützung. Wir bleiben auch hier unserem Grundsatz der Datensparsamkeit treu. Die Verwendung von personenbezogenen Daten ist in der derzeitigen Form der Nutzung nicht erforderlich. Da wir nicht ausschließen können, dass in Dialogsituationen personenbezogene Daten verwendet werden, arbeiten wir mit regelbasierten Mechanismen, die verhindern, dass offensichtlich personenbezogene Daten in das System gelangen.

Bei der Entscheidungsunterstützung, also wenn es um die Vorbereitung und Unterstützung von Diagnose und Therapie geht, setzen wir weiterhin auf unsere zertifizierten Medizinprodukte. Wir glauben auch, dass letztlich die Kombination unserer Software as a Medical Device (SaMD) und MedLLMs der eigentliche Game Changer sein wird.